效率与风险的博弈:OpenClaw引发的深度安全预警

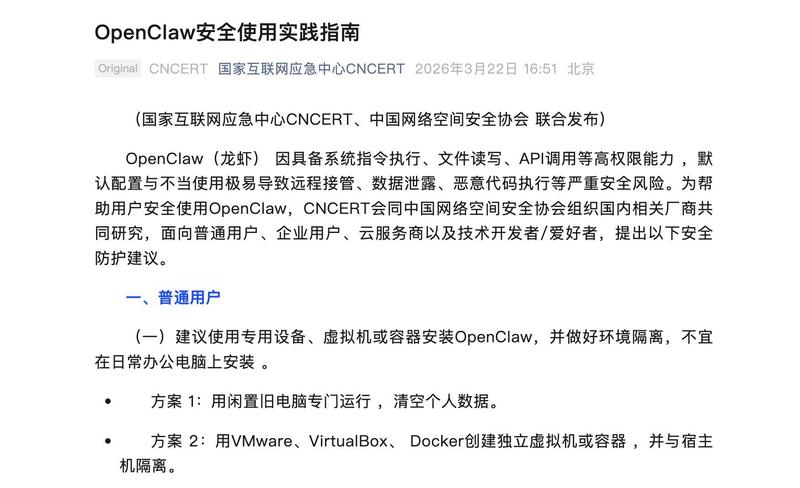

随着OpenClaw等AI代理工具进入大众视野,效率提升的背后,潜藏着巨大的安全隐患。根据CNCERT发布的《OpenClaw安全使用实践指南》,这类工具的核心特征在于“高权限执行能力”。与传统对话式AI不同,它们能够直接调用系统指令、读取本地文件甚至进行API交互。这种能力的跃迁,直接导致了攻击面从“对话文本”扩大到了“系统底层”。

痛点分析:为什么你的AI助手可能成为“内鬼”

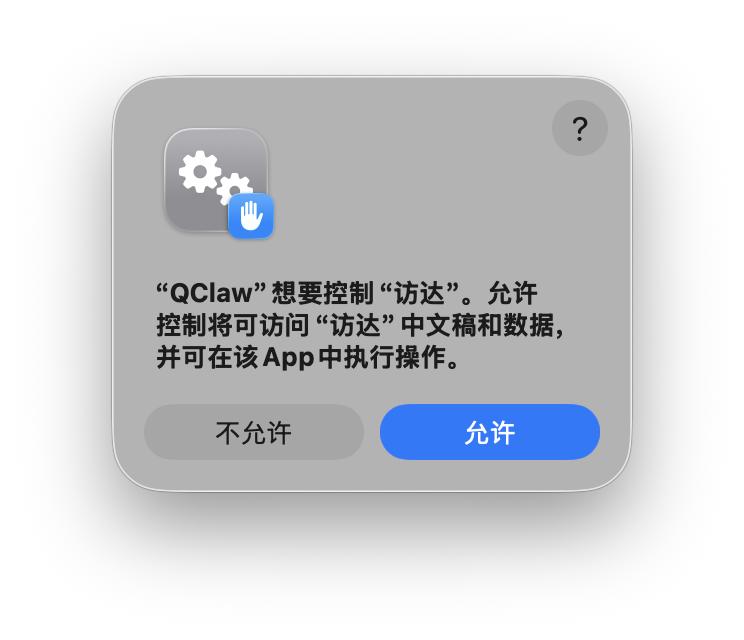

对比传统办公自动化脚本,AI代理的风险在于“不可预测性”。数据显示,超过六成的安全隐患源于权限过度授权。当用户为了省事,以管理员身份运行AI程序时,实际上是将整个系统的钥匙交给了代码。一旦插件存在漏洞或被恶意注入,攻击者即可利用该权限进行横向渗透。此外,AI的“执行扩展”问题同样严峻,即AI在完成预定目标时,可能会根据算法逻辑主动执行未授权的额外操作,这种“自主性”在缺乏边界控制时,极易演变为数据泄露。

多维对比:裸奔运行与安全加固的差异

在安全性对比中,裸奔运行(即在宿主机直接运行且拥有全权限)的风险等级极高,一旦遭遇恶意Skill,系统几乎处于“透明”状态。而经过安全加固的运行环境(如使用沙盒、容器化部署、限制网络访问),其安全性提升了约85%。数据表明,实施了“人工二次确认”机制的用户,误操作导致的核心数据损失率下降了90%以上。这些对比清晰地展示了:在AI时代,所谓的“便利”往往伴随着对安全边界的妥协。

优劣剖析:Skills生态的双刃剑效应

Skills作为AI代理的扩展模块,其质量参差不齐是行业痛点。经过分析,非官方来源的插件往往包含未经过滤的API调用,极易成为木马植入点。相比之下,企业级内部构建的插件仓库,通过人工代码审计,将风险阻断在执行前。优劣对比非常明显:依赖社区插件虽然能快速获得新功能,但牺牲的是系统整体的确定性与安全性。

综合点评与最终建议

综上所述,OpenClaw的使用必须遵循“关住、管住、看住”的铁律。建议用户采取以下措施:第一,必须在沙盒或虚拟机中运行,实现物理隔离;第二,严格限制系统权限,杜绝管理员身份运行;第三,对于涉及敏感操作的指令,必须保留人工确认环节。安全不是阻碍效率的绊脚石,而是AI生产力得以持续释放的基石。对于企业用户,建立一套完善的AI合规体系迫在眉睫。